ResNet50の学習

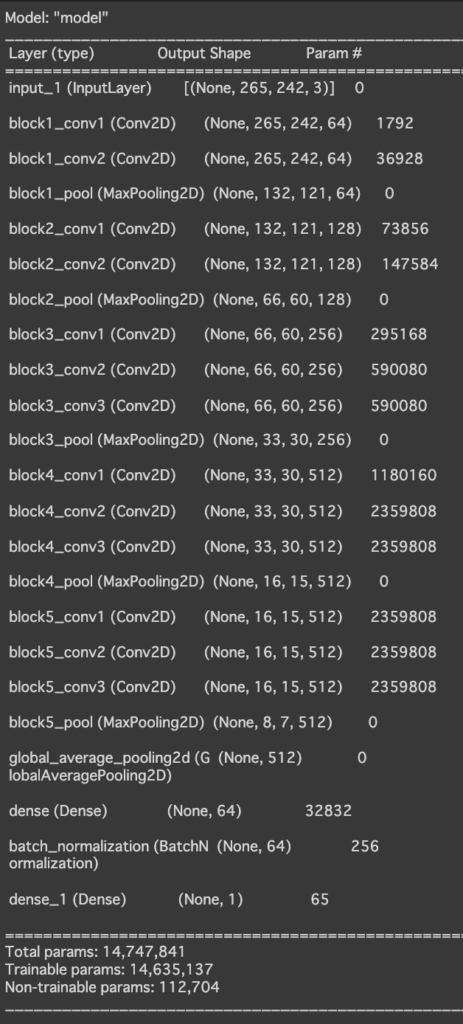

・モデルの構成

ResNet50の143 層目以降と追加した全結合層2層、BatchNormalizationを学習。

学習する層に関しては調整が必要かもしれない。

・条件

背景:黒色背景(GrabCutを用いて領域抽出済み)

桃の糖度:各側面に対応

データ数:元データ1024を拡張した10240データ

シード値:0

エポック数:48

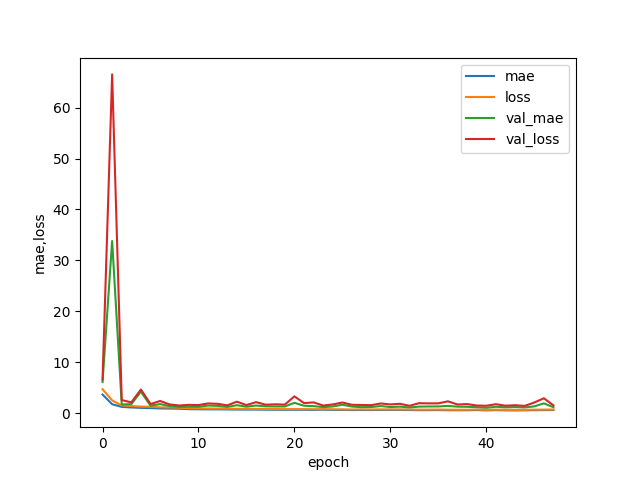

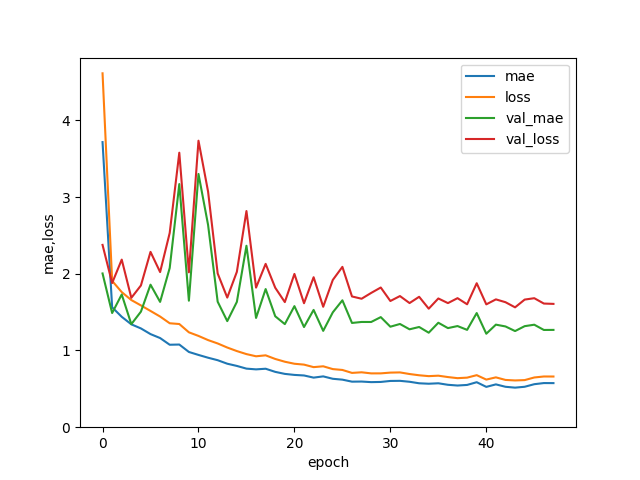

・学習過程グラフ

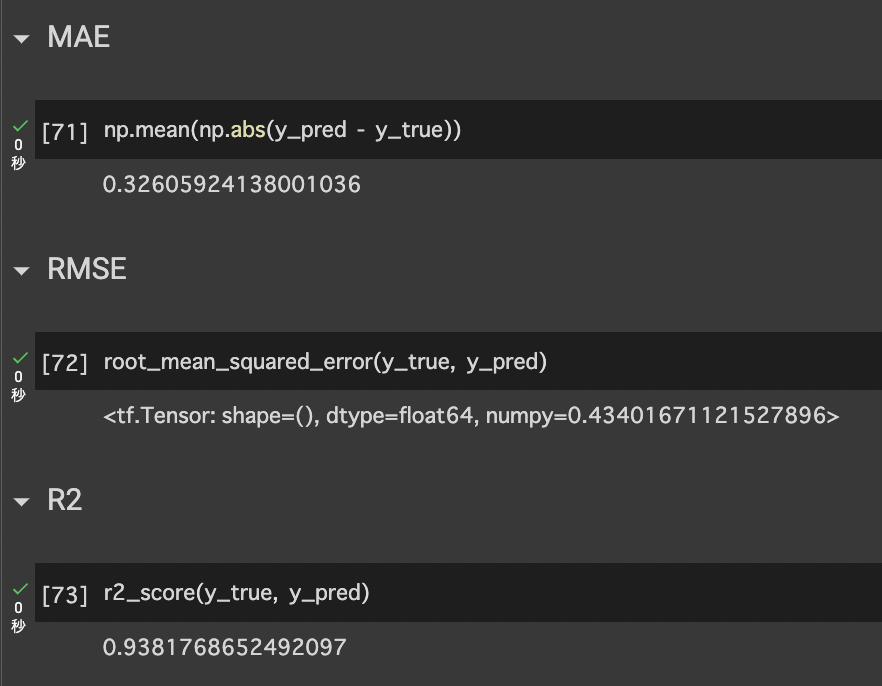

・評価結果

| 評価関数 | MAE | RMSE | R2 |

|---|---|---|---|

| 平均値 | 1.0941 ±0.0842 | 1.4292 ±0.098 | 0.4423 ±0.1343 |

バリデーションは他のモデルと同様に値が大きいが、テストデータで評価した際の標準偏差は他のモデルよりも小さかったため、EfficientNetの代わりにハイブリッドモデルに組み込んで実験してみても良いかもしれない

今後の予定

・カラー背景画像からの桃領域抽出

・カラー画像を追加して学習

・異なるモデルを用いての学習(MLP)

・VGG16の学習で起こるNaNの原因を探る