やったこと

・EfficientNetB3の学習・評価

・Xceptionの学習・評価

・条件

背景:黒色背景(GrabCutを用いて領域抽出済み)

桃の糖度:各側面に対応

データ数:元データ1024を拡張した10240データ

シード値:0

エポック数:48

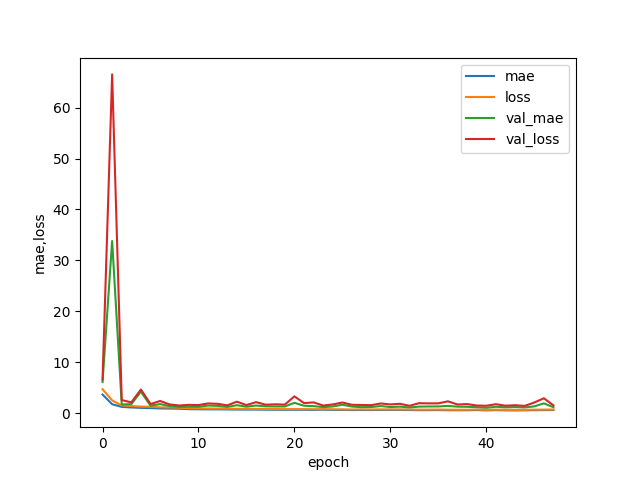

EfficientNetB3の学習・評価

・モデルの構成

EfficientNetの上位層56 層と追加した全結合層2層、BatchNormalizationを学習。

・学習過程グラフ

・評価結果

| 評価関数 | MAE | RMSE | R2 |

|---|---|---|---|

| 平均値 | 1.8632 ±1.6645 | 9.6076 ±16.4205 | -64.2575 ±129.3921 |

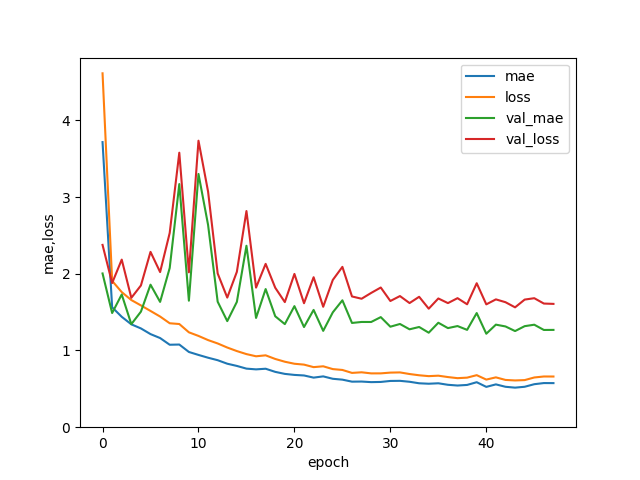

Exceptionの学習・評価

・モデルの構成

Xceptionの108層以降と追加した全結合層2層、BatchNormalizationを学習。

・学習過程グラフ

・評価結果

| 評価関数 | MAE | RMSE | R2 |

|---|---|---|---|

| 平均値 | 1.3703 ±0.0524 | 1.7371 ±0.0632 | 0.178 ±0.1569 |

まとめ

前回と同様、どちらも収束しなかった。

とりあえずはVGG16で起きたNaNの原因を探りつつ、ResNet50とMLPの学習を進めていく。

今後の課題

・カラー背景画像からの桃領域抽出

・カラー画像を追加して学習

・異なるモデルを用いての学習(ResNet50、MLPなど)

・VGG16の学習で起こるNaNの原因を探る