今週は、前回エラーが出たカメラの部分を修正しました。

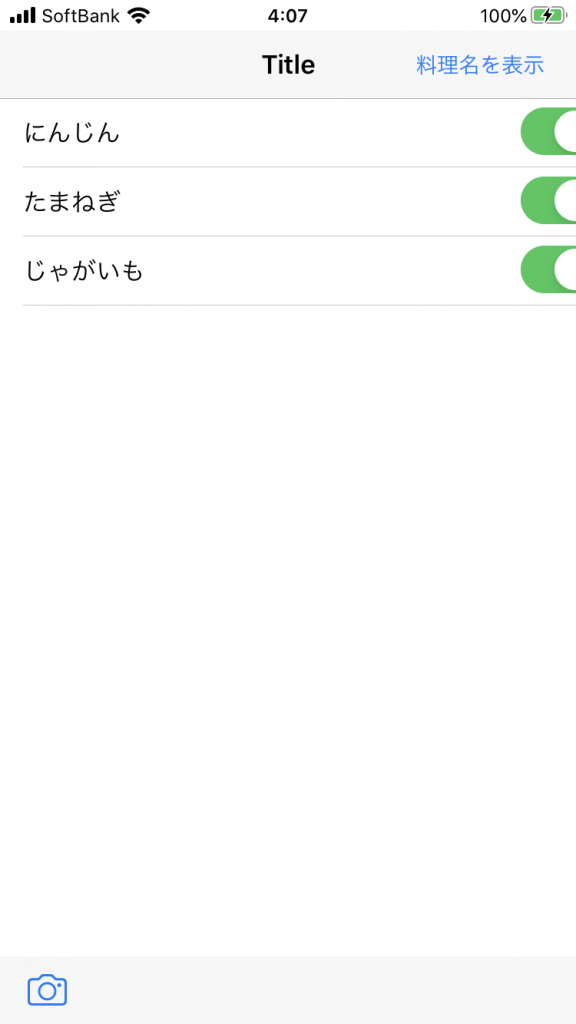

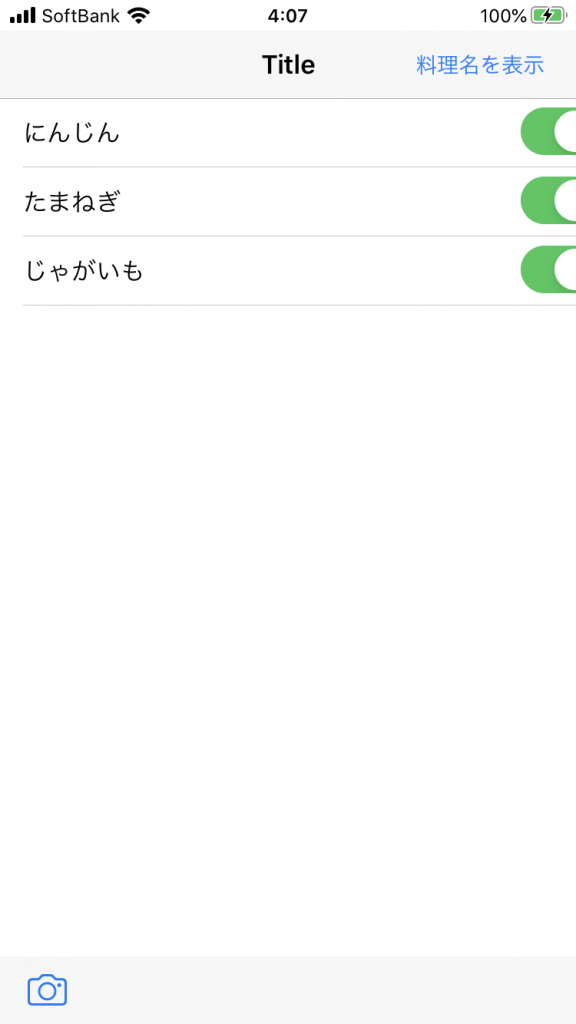

仮の学習データを使って、カメラで撮った野菜(にんじん、たまねぎ、じゃがいも )をリストに追加するところまでが完成しました。

次は、野菜を選んで料理名を表示し、ウェブサイトまで移動する機能を実装したいと思います。

今週は、前回エラーが出たカメラの部分を修正しました。

仮の学習データを使って、カメラで撮った野菜(にんじん、たまねぎ、じゃがいも )をリストに追加するところまでが完成しました。

次は、野菜を選んで料理名を表示し、ウェブサイトまで移動する機能を実装したいと思います。

上野

今週はswiftで野菜の名前を表示するページと、レシピ名が表示されるページの二つのページを用意しました。

実機で確認したところ、カメラが動かないなどのエラーが出たので直していきたいです。

また、家に丸々一個キャベツがあったので、写真を撮りました。照明が明るい写真・若干くらい写真・常夜灯の三種類の明るさを用意しました。

山本

愛名会やテスト勉強で、時間がとれず、あまり進展してないです。それでも、キャベツとにんじんとじゃがいもの仮の学習データは作成しました。

今週はswiftで野菜の名前を表示するページと、レシピ名が表示されるページの二つのページを用意しました。

まだ動かしていないので、野菜の学習モデルを使って判定した野菜がリストに表示されるかどうかを試していきたいと思います。

また、家に丸々一個キャベツがあったので、写真を撮りました。照明が明るい写真・若干くらい写真・常夜灯の三種類の明るさを用意しました。

今週は、夏課題のときに集めた学習データ用の野菜の写真を山本君に渡しました。コーディングは、最初の画面を用意するところまでしか進んでいないので、カメラに映った野菜を判別し、リストに追加するというところを進めていきたいと思います。

集める予定だったレシピのURLは木曜の発表までに集めておきたいと思います。

今週はアプリの仕様をより詳しく考えていきました。

夏課題の時点では、カメラに映った野菜からレシピを表示させていましたが、今回はカメラに映った野菜の種類を判定して、リストに野菜の名前を追加し、リストから使用する野菜を選んでレシピを表示するアプリに変更したいと考えています。

今後はアプリの実装方法を考えつつ、野菜の学習に使う画像を撮影して集めていきます。

機械学習にはCoreMLを使う予定です。